1. O que é LangChain

2. Como o LangChain funciona na prática

3. Os principais componentes do framework

4. Por que o LangChain importa para empresas que desenvolvem com IA

5. LangChain e LangGraph: frameworks diferentes para problemas diferentes

6. LangChain no ecossistema de inteligência artificial

7. Conclusão

LangChain é um framework de código aberto projetado para simplificar o desenvolvimento de aplicações baseadas em grandes modelos de linguagem (LLMs).

Quando uma empresa decide construir uma aplicação com inteligência artificial, o maior desafio raramente é o modelo de linguagem em si. O desafio está em conectar esse modelo ao restante do sistema: bases de dados internas, APIs externas, histórico de conversas, fluxos de decisão. É para resolver esse problema de integração e orquestração que o LangChain foi criado.

Lançado por Harrison Chase em outubro de 2022, o projeto cresceu rapidamente: em junho de 2023, era o repositório de código aberto de crescimento mais rápido no GitHub, segundo dados públicos da plataforma. Sua popularidade reflete uma necessidade real do mercado de desenvolvimento com IA.

Este artigo explica o que é o LangChain, como ele funciona, quais são seus diferenciais em relação ao LangGraph, e por que ele se tornou uma peça central no ecossistema de inteligência artificial aplicada a negócios. Continue lendo para saber mais!

LangChain é um framework de orquestração de código aberto, disponível em Python e JavaScript, que fornece uma interface padronizada para conectar modelos de linguagem a fontes de dados externas, ferramentas e fluxos de trabalho complexos.

Em vez de ser o modelo de linguagem em si, o LangChain atua como a camada de integração entre o LLM e o ambiente em que ele precisa operar.

A metáfora mais precisa é a de um orquestrador: o LangChain define o que acontece antes e depois de cada chamada ao modelo, quais dados entram, quais ferramentas são acionadas e em que ordem as etapas se sucedem.

Sem esse tipo de framework, um desenvolvedor precisaria escrever manualmente todo esse código de integração, o que aumenta o tempo de desenvolvimento e a complexidade de manutenção.

O projeto surgiu em um momento em que os LLMs já eram tecnicamente capazes, mas o ecossistema de ferramentas para usá-los em produção ainda era escasso. O LangChain preencheu essa lacuna ao oferecer abstrações reutilizáveis que aceleram a prototipagem e a entrega de soluções funcionais.

O princípio central do LangChain é o encadeamento, que dá nome ao próprio framework. Uma "chain" (cadeia) é uma sequência de operações onde a saída de cada etapa se torna a entrada da próxima. Essa estrutura permite modelar fluxos de trabalho complexos de forma modular e organizada.

Um exemplo concreto: uma aplicação corporativa que responde perguntas sobre documentos internos pode ser construída com LangChain em três etapas encadeadas. Primeiro, o sistema carrega e indexa os documentos. Em seguida, quando o usuário faz uma pergunta, um mecanismo de recuperação busca os trechos mais relevantes.

Por fim, o modelo de linguagem recebe esses trechos como contexto e gera a resposta. Cada uma dessas etapas é um componente independente que pode ser trocado ou reconfigurado sem reescrever todo o sistema.

Esse padrão, conhecido como RAG (Retrieval-Augmented Generation), é um dos casos de uso mais comuns do LangChain. Contudo, o framework suporta muito além disso: chatbots com memória de conversação, agentes que decidem dinamicamente quais ferramentas usar, pipelines de extração e sumarização de texto, e automações que integram APIs externas ao raciocínio do modelo.

O LangChain é construído sobre um conjunto de módulos que trabalham em conjunto. Entender cada um deles ajuda a compreender o que o framework torna possível.

Os modelos de linguagem são o núcleo de qualquer aplicação LangChain. O framework oferece uma interface padronizada para conectar LLMs de diferentes provedores, como OpenAI, Anthropic, Google e modelos de código aberto via Hugging Face. Isso permite trocar o modelo subjacente com mudanças mínimas no código.

Os prompts e templates estruturam as instruções enviadas ao modelo. O LangChain oferece ferramentas para criar, versionar e reutilizar templates de prompt, o que padroniza a forma como o sistema se comunica com o LLM e facilita experimentação e ajuste fino.

As chains são as sequências de operações mencionadas anteriormente. A chain mais básica combina um template de prompt com uma chamada ao modelo. Chains mais complexas encadeiam múltiplas etapas de processamento, recuperação de dados e chamadas a ferramentas externas.

Os agentes são componentes que tomam decisões dinâmicas sobre quais ações executar. Em vez de seguir uma sequência predefinida, um agente usa o modelo de linguagem para decidir, a cada passo, qual ferramenta acionar com base no contexto atual da tarefa.

A memória resolve um dos principais desafios dos LLMs: a falta de persistência entre interações. Os módulos de memória do LangChain permitem que aplicações retenham histórico de conversação e contexto ao longo do tempo, tornando sistemas de chat mais coerentes e personalizados.

A adoção de inteligência artificial em empresas enfrenta um gargalo consistente: a distância entre o que um modelo de linguagem é capaz de fazer isoladamente e o que uma aplicação corporativa real exige.

Modelos genéricos não têm acesso a dados proprietários, não conhecem os sistemas internos da empresa e não conseguem executar ações fora do escopo de uma conversa. O LangChain é a infraestrutura que reduz essa distância.

Para times de tecnologia, o framework reduz drasticamente o volume de código personalizado necessário para integrar LLMs a sistemas existentes.

Componentes prontos para RAG, gerenciamento de memória, integração com bancos de dados vetoriais e APIs externas eliminam meses de desenvolvimento de infraestrutura que, de outra forma, precisariam ser construídos do zero.

Para gestores e decisores, o valor está na velocidade de prototipagem e na modularidade da arquitetura. Uma solução construída com LangChain pode começar simples, com um chatbot de documentos, e evoluir para um sistema multi-agente sofisticado sem que a arquitetura precise ser descartada e reconstruída. Essa capacidade de crescimento incremental é especialmente relevante para empresas que estão estruturando sua maturidade em IA.

Além disso, por ser de código aberto com uma comunidade ativa e extenso ecossistema de integrações, o LangChain reduz a dependência de um único fornecedor de IA. A empresa pode trocar o modelo de linguagem subjacente, adicionar novas fontes de dados ou integrar novas ferramentas à medida que o mercado evolui.

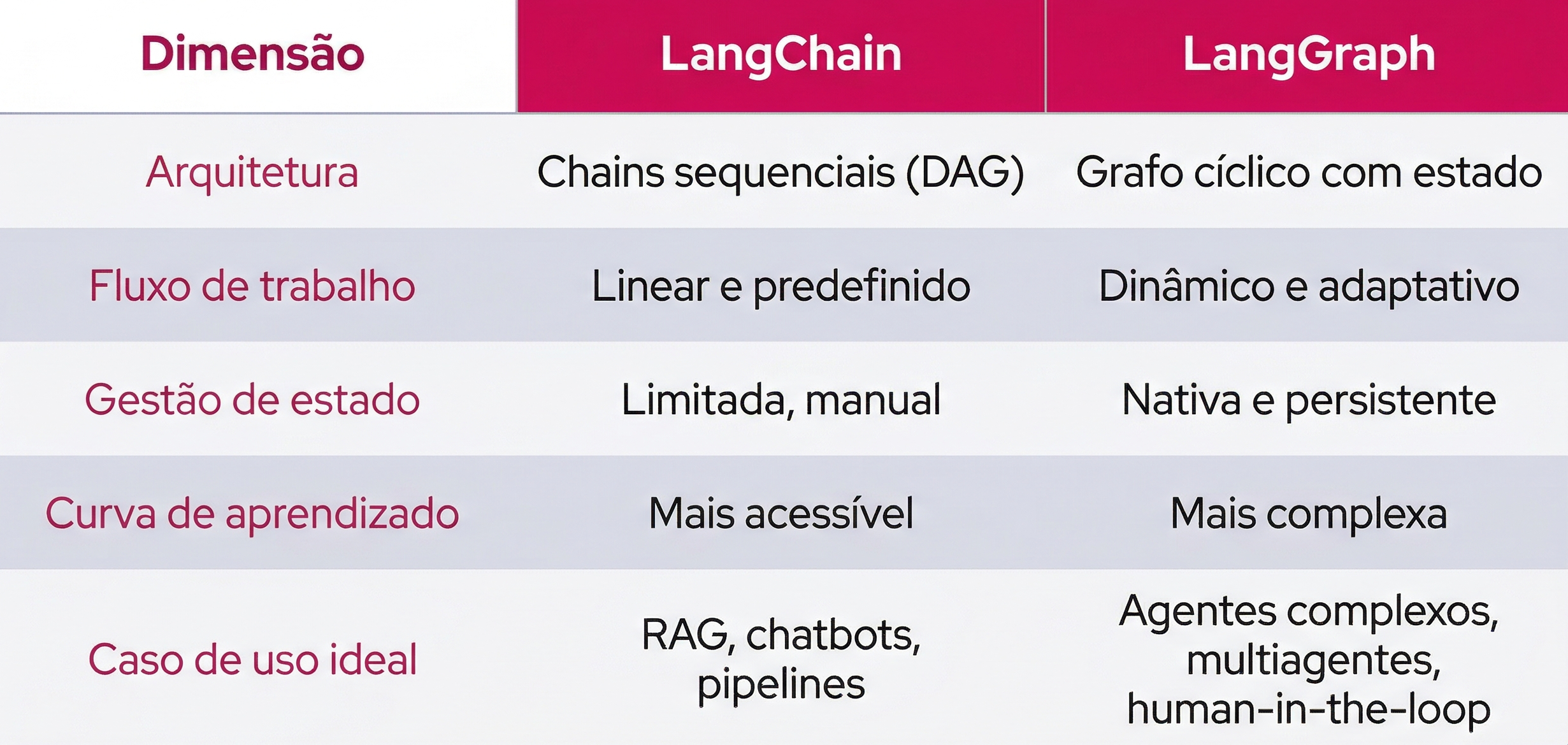

Um ponto de confusão frequente no ecossistema é a relação entre LangChain e LangGraph. Os dois projetos vêm da mesma empresa e são complementares, mas operam em camadas distintas da arquitetura de agentes de IA.

O LangChain é a camada de framework e ergonomia. Ele oferece os blocos de construção — modelos, prompts, chains, agentes, ferramentas — e é ideal para fluxos de trabalho sequenciais e bem definidos.

Sua arquitetura segue um padrão de grafo acíclico dirigido (DAG), o que significa que a execução vai em uma direção e não pode voltar sobre si mesma. É a escolha certa para protótipos, pipelines de RAG, chatbots e aplicações onde a sequência de etapas é conhecida de antemão.

O LangGraph, por sua vez, é a camada de orquestração e runtime. Ele foi projetado para agentes com estado persistente e fluxos de trabalho não-lineares, onde o próximo passo depende de condições que só existem em tempo de execução.

Em vez de chains lineares, o LangGraph modela o sistema como um grafo com nós (tarefas) e arestas (transições), suportando loops, ramificações condicionais, retentativas e até intervenção humana no meio do processo.

Na prática, times maduros costumam usar os dois: começa-se com as abstrações do LangChain para construir rapidamente, e recorre-se ao LangGraph quando o fluxo exige controle mais granular sobre estado, loops e comportamentos não-lineares.

Inclusive, os agentes criados com a interface do LangChain já rodam, internamente, sobre o runtime do LangGraph — o que torna a transição entre os dois natural e progressiva.

O LangChain ocupa uma posição específica no ecossistema mais amplo de inteligência artificial: não é um modelo, não é uma plataforma de infraestrutura e não é uma ferramenta de baixo código. É o middleware que conecta modelos de fundação a aplicações reais de negócio.

Nesse ecossistema, o LangChain coexiste com outras camadas. Os modelos de linguagem, como GPT-4, Claude e Gemini, fornecem a capacidade de raciocínio e geração.

Os bancos de dados vetoriais, como Pinecone e Chroma, fornecem a infraestrutura de recuperação semântica. Os frameworks de observabilidade, como LangSmith (do próprio ecossistema LangChain), permitem monitorar e depurar o comportamento dos agentes em produção.

O papel do LangChain é orquestrar essas camadas de forma coesa. Isso o torna relevante tanto para arquiteturas simples, como um chatbot de atendimento com base de conhecimento, quanto para sistemas complexos, como plataformas de automação com múltiplos agentes especializados operando em paralelo.

Para organizações que adotam IA de forma estruturada, entender o LangChain é entender como soluções de IA saem do protótipo e chegam à produção. O framework não elimina a necessidade de engenharia sólida, mas reduz significativamente o esforço para construir, iterar e escalar aplicações baseadas em linguagem.

Em suma, o LangChain representa uma camada essencial na jornada de qualquer empresa que pretende construir soluções de IA além do uso básico de chatbots genéricos.

Ele resolve o problema real de integração: como conectar modelos de linguagem a dados proprietários, sistemas internos e fluxos de trabalho corporativos de forma estruturada, modular e escalável.

Para gestores e times de tecnologia, compreender o framework é um passo concreto para sair da fase de experimentação e levar IA a produção com arquitetura robusta.

Conheça o AI Factory do Distrito e veja como sua empresa pode construir soluções de IA proprietárias com LangChain e outros frameworks de agentes, do caso de uso inicial ao go-live em produção, com arquitetura segura e foco em resultados mensuráveis.