1. O que é o DeepSeek V4 e quais são suas variantes

2. Arquitetura: o que há de novo sob o capô

3. Desempenho: onde o V4-Pro se destaca e onde fica atrás

4. Preço: a equação que força reavaliações

5. Capacidades agênticas: foco em automação de desenvolvimento

6. Soberania de dados e vantagem regulatória

7. O que muda para empresas que adotam IA

8. Como avaliar se o DeepSeek V4 é a escolha certa para sua empresa

O DeepSeek V4, lançado em 24 de abril de 2026, voltou a sacudir o mercado global de inteligência artificial. A startup chinesa entregou dois modelos — V4-Pro e V4-Flash — com uma combinação que raramente aparece no setor: desempenho de fronteira, código aberto e preço agressivo. Para gestores e executivos que acompanham a adoção de IA nas empresas, o lançamento levanta questões práticas sobre escolha de modelo, custo de infraestrutura e posicionamento estratégico.

O contexto importa. Em janeiro de 2025, o DeepSeek R1 igualou o desempenho do OpenAI o1 a uma fração do custo e chegou a derrubar as ações da NVIDIA em um único pregão. O V4 eleva esse padrão. Segundo a MIT Technology Review, o V4-Pro compete diretamente com Claude Opus 4.6, GPT-5.4 e Gemini 3.1 nos principais benchmarks. Além disso, supera todos os modelos open source anteriores em codificação, matemática e STEM.

Compreender o que o DeepSeek V4 representa — e o que não representa — é parte do trabalho de qualquer organização que esteja construindo uma estratégia de IA sólida para 2026.

O DeepSeek V4 é uma família de modelos de linguagem de grande escala desenvolvida pelo laboratório chinês DeepSeek. O lançamento ocorreu em 24 de abril de 2026 e a família inclui duas variantes: o V4-Pro e o V4-Flash.

O V4-Pro é o modelo flagship, com 1,6 trilhão de parâmetros totais e 49 bilhões de parâmetros ativos. Ele utiliza uma arquitetura Mixture of Experts (MoE). Com isso, apenas uma fração dos parâmetros é ativada por inferência, tornando o processamento mais eficiente. O V4-Flash é a versão compacta, com 284 bilhões de parâmetros totais e 13 bilhões ativos. Foi projetado para cargas de trabalho que exigem velocidade e economia.

Ambos os modelos oferecem janela de contexto padrão de 1 milhão de tokens. Também suportam modos de raciocínio (Thinking/Non-Thinking) e estão disponíveis via API, interface web e download de pesos abertos no Hugging Face sob licença MIT.

Para equipes técnicas em transição de modelos legados, a API mantém compatibilidade com os formatos OpenAI ChatCompletions e Anthropic. Basta atualizar o parâmetro de modelo para deepseek-v4-pro ou deepseek-v4-flash. Vale notar: os modelos deepseek-chat e deepseek-reasoner serão descontinuados em 24 de julho de 2026.

A principal inovação técnica do V4 está na atenção. O modelo introduz compressão token-wise combinada com DSA — DeepSeek Sparse Attention. Trata-se de uma forma de atenção esparsa que reduz drasticamente o consumo de memória e custo computacional em contextos longos. Esse mecanismo é o que permite que 1 milhão de tokens se torne padrão em vez de diferencial de nicho.

Segundo o relatório técnico publicado pela DeepSeek no Hugging Face, o V4-Pro foi pré-treinado em mais de 32 trilhões de tokens. Com isso, consolidou capacidades de conhecimento de mundo que superam todos os modelos open source atuais. Fica atrás apenas do Gemini 3.1 Pro entre os modelos fechados.

A combinação de MoE com atenção esparsa resolve um gargalo histórico dos modelos de grande escala: o custo proibitivo de processar contextos longos em produção. Para empresas que trabalham com documentos extensos, bases de código complexas ou fluxos de dados contínuos, essa eficiência representa uma diferença concreta na viabilidade de implementação.

Essa inovação arquitetural também impacta o custo de hospedagem própria. O V4-Pro, com seus 865 GB de pesos, já é viável para infraestruturas corporativas de médio porte — especialmente quando o caso de uso exige controle de dados.

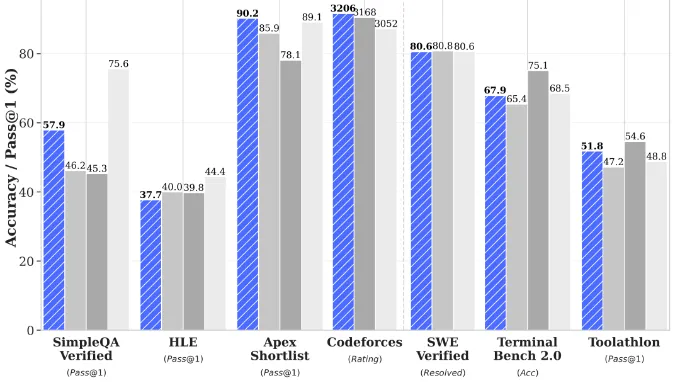

Os benchmarks divulgados posicionam o V4-Pro como o modelo open source mais forte disponível hoje. Em codificação, o destaque é o rating Codeforces de 3.206 pontos. Esse número supera o GPT-5.4 (3.168) e representa a maior pontuação em programação competitiva registrada por qualquer modelo no momento do lançamento, segundo análise publicada pelo Codersera.

No SWE-bench Verified — benchmark que mede a capacidade de resolver problemas reais de engenharia de software — o V4-Pro marcou 80,6%. Isso fica dentro de 0,2 ponto percentual do Claude Opus 4.6 (80,8%). No LiveCodeBench, o V4-Pro superou o Claude com 93,5% contra 88,8%.

Onde o V4-Pro fica atrás: raciocínio de alto nível (HLE) e matemática avançada (HMMT 2026). Nessas categorias, o Claude Opus 4.6 mantém vantagem. Para cargas de trabalho que exigem precisão em raciocínio factual, o contexto competitivo é mais equilibrado do que os números de codificação sugerem.

Em uma pesquisa interna com 85 desenvolvedores experientes — citada pela MIT Technology Review — mais de 90% incluíram o V4-Pro entre suas principais escolhas para tarefas de codificação.

A combinação de desempenho e preço do DeepSeek V4 é onde o impacto estratégico se torna mais concreto. O V4-Pro custa US$ 1,74 por milhão de tokens de entrada e US$ 3,48 por milhão de tokens de saída. Para efeitos de comparação, segundo a DataCamp, esse valor está muito abaixo do GPT-5.5 e do Claude Opus 4.7.

O V4-Flash vai mais longe: US$ 0,28 por milhão de tokens de saída, o que representa 12,4 vezes mais barato que o Pro. O desempenho no SWE-bench Verified do Flash é de 79% — apenas 1,6 ponto percentual abaixo do V4-Pro.

Para organizações que operam agentes de codificação em alto volume, a matemática é direta: desempenho equivalente ao topo do mercado a uma fração do custo dos modelos proprietários líderes. Essa equação muda o cálculo de build vs. buy para dezenas de casos de uso empresariais.

Do ponto de vista de estratégia de IA, o preço não é o único fator relevante. No entanto, quando a diferença é de 7x em relação ao concorrente mais próximo com performance similar, o argumento econômico passa a fazer parte da conversa no nível de diretoria.

Uma das apostas centrais do DeepSeek V4 é a capacidade agêntica. Em outras palavras: a habilidade de executar tarefas com múltiplos passos, usar ferramentas e manter contexto ao longo de sequências de ações. O V4-Pro foi integrado nativamente a ferramentas como Claude Code e OpenCode. A DeepSeek afirma que o modelo já está sendo usado internamente para codificação agêntica.

Para empresas que estão construindo ou avaliando fluxos de automação com agentes de IA — desde geração de código até revisão de documentos e análise de dados — o V4 representa uma opção com suporte explícito a casos de uso agênticos. Além disso, oferece janela de contexto suficiente para tarefas complexas e custo operacional competitivo.

A IA agêntica é um dos vetores de maior impacto para organizações que já passaram da fase de experimentos e estão em modo de escala. Entender quais modelos suportam esses fluxos com eficiência é parte da decisão de arquitetura — não apenas da equipe técnica.

Um aspecto frequentemente negligenciado nas comparações de modelos é o controle de dados. Por ser open source com licença MIT, o DeepSeek V4 pode ser hospedado internamente ou em nuvem privada. Essa característica tem peso significativo para setores regulados como financeiro, saúde e jurídico.

Empresas sujeitas à LGPD, ao regulamento europeu de IA ou a normas setoriais específicas enfrentam restrições reais ao usar APIs de terceiros com dados sensíveis. Com o V4, é possível processar esses dados em infraestrutura própria, sem dependência de fornecedor externo.

Esse ponto muda a natureza da decisão. Não se trata apenas de escolher o modelo mais performático ou mais barato. Trata-se de escolher o modelo que se encaixa na arquitetura de dados e nos requisitos de conformidade da organização.

O lançamento do DeepSeek V4 reforça uma tendência que vem se consolidando: o custo de acesso a modelos de fronteira vai cair de forma consistente. A diferença entre open source e proprietário vai continuar diminuindo em casos de uso selecionados.

Para lideranças que estão definindo a estratégia de IA para os próximos 12 a 18 meses, três implicações práticas se destacam.

A primeira é a revisão de custos de infraestrutura. Se uma organização usa modelos proprietários caros para cargas de trabalho de codificação ou processamento de documentos, o V4 oferece uma alternativa com desempenho comparável a custos muito menores.

A segunda é a questão de soberania de dados. Por ser open source com licença MIT, o V4 pode ser hospedado internamente. Isso é relevante para setores regulados como financeiro, saúde e jurídico.

A terceira é a velocidade de ciclo. Com benchmarks agênticos fortes e integração com ferramentas existentes, o V4 pode acelerar ciclos de desenvolvimento interno. Isso vale desde automação de revisão de código até geração de documentação técnica.

Nenhuma dessas decisões é simples. A escolha do modelo certo depende do caso de uso, do contexto regulatório, da maturidade da equipe técnica e da visão de longo prazo da organização. Estruturar essa decisão dentro de um roadmap de IA coerente é o passo seguinte — e é aqui que uma estratégia bem definida faz diferença.

A resposta direta: depende. Nenhum modelo é universalmente superior para todos os casos de uso. Por isso, a avaliação deve partir do problema, não do benchmark.

Para cargas de trabalho de codificação em alto volume — como squads de engenharia que usam agentes de revisão de código ou geração de testes — o V4-Pro e o V4-Flash apresentam uma relação preço-desempenho que merece análise séria. Para tarefas que exigem raciocínio factual profundo, como análise jurídica ou pesquisa científica, modelos como o Claude Opus 4.6 ainda mantêm vantagem nas categorias específicas que importam.

Para empresas no início da jornada de adoção de IA — sem infraestrutura dedicada, sem equipe treinada e sem critérios claros de avaliação — a escolha do modelo é a última decisão a ser tomada, não a primeira. Antes disso, é necessário entender quais processos se beneficiam de automação inteligente, qual é o apetite de risco regulatório da organização e como a IA se integra à estratégia de negócio.

O DeepSeek V4 é mais um dado em uma curva que já estava clara: o acesso a modelos de alta capacidade deixou de ser diferencial por si só. O que separa organizações que geram valor real com IA das que ficam no ciclo de experimentos é a qualidade da estratégia que governa a adoção. Isso inclui escolha de modelo, arquitetura de dados, governança, capacitação de times e critérios de escala.

O Distrito acompanha esse cenário de perto e apoia empresas na construção de estratégias de IA que vão além da escolha de ferramenta. Conheça o AI Strategy e entenda como estruturar um roadmap de IA que funcione no mundo real.